近年、話題の画像生成AI「Luma Dream Machine」は、写真や映像をリアルに動かす画期的なツールとして注目されています。しかしその一方で、「不適切な画像が出るのでは?」「子どもが使っても大丈夫?」といった危険性を懸念する声も増えています。

本記事では、Luma Dream Machineのリスク・トラブル事例・安全な使い方について、実例を交えてやさしく解説します。

- Luma Dream Machineで懸念される危険性を網羅的に紹介

- 不適切な画像が生まれる理由と背景を丁寧に解説

- 法律・モラル面のリスクを避ける具体策を提案

- 子ども・企業が安全に使うためのガイドラインも紹介

luma dream machine 危険性は?利用前に知るべきリスクとは

- セキュリティと監視体制は万全か?

- プライバシー情報が漏れる危険はある?

- 子どもに使わせても大丈夫?

- 商用利用でトラブルになる可能性は?

- 著作権侵害になるケースはある?

- 海外発サービスの利用規約に注意点は?

- 他の生成AIとのリスク比較は?

- 危険性を最小化する使い方は?

- 利用時に避けるべきプロンプトや設定は?

- AIが生成する内容に偏りはある?

- 日本ユーザー特有の注意点はある?

Lumaのセキュリティ対策はどこまで万全?

LumaではGoogleアカウントを使用したログイン認証が採用されており、不正アクセスに対する基本的なアカウント保護対策は実施されています。しかし、その一方で、生成コンテンツの監視・制限機能は非常に限定的であり、セキュリティ面での対応はあくまでも「外部からの侵入を防ぐ」ことにとどまっています。

AIが生成する画像や動画は、Luma側のサーバーで処理されますが、どのようなプロンプトが入力され、どのような内容が生成されたかの詳細な記録やモニタリング体制は整備されていないのが現状です。

たとえば、センシティブな画像や他人の肖像を含む内容をユーザーが生成しても、それが即時に検出・削除されるとは限らず、トラブルが発覚するまで見過ごされるケースも少なくありません。

つまりLumaは「自己責任型」のツールであり、ユーザー自身がリスクを理解し、適切に管理して使う前提の設計です。システム側の保護機能に依存しすぎず、自衛意識を持って活用することが求められます。

プライバシー情報が漏れる危険は?

Lumaでは、アップロードされた写真や映像、入力されたプロンプトがどのように記録・処理されているのかについて明確なガイドラインが示されていません。

そのため、たとえば自分や他人の顔写真を素材に使った場合、それらの情報が内部的に保存・学習データとして再利用される可能性がある点には十分注意が必要です。

実際、類似のAIサービスでは「アップロード画像が運営側のAIモデルに組み込まれてしまった」という報告があり、ユーザーが意図しない形で個人情報が外部に漏れるリスクが指摘されています。

特に以下のようなケースでは、プライバシー侵害に繋がる可能性が高まります。

- 本名や住所が記載された画像をアップロード

- 他人の顔写真をプロンプトに使用

- 子どもの画像をプロモーション素材として使う

AI生成の精度が高まる一方で、プライバシーとのバランスは依然として課題です。「絶対に知られたくない情報は、最初から使わない」ことが最も安全な対策と言えるでしょう。

子どもに使わせても大丈夫?

結論から言えば、現時点では保護者の監視なしに子どもが使うのは危険です。Lumaには明確な年齢制限がなく、登録や使用に際して生年月日の入力も不要なため、未成年が簡単に利用できてしまう状況にあります。

操作性が直感的で分かりやすく、絵やアニメに関心のある子どもには魅力的に映る反面、プロンプトの入力によっては意図せずセンシティブな画像や過激な表現が出力される恐れがあります。

また、子どもが生成した画像を無自覚にSNSへアップロードし、炎上や誹謗中傷に発展するケースも想定されます。

安全に使わせるためには、以下の工夫が必要です。

- フィルタリング機能付きの端末で管理

- 使用時間や使用場所のルールを明確化

- 出力内容は保護者が都度確認する

AIツールを教育的に活用する取り組みも進んでいますが、「自動生成の中身は予測不能である」という点を忘れず、親子でリスクを共有しておくことが大切です。

商用利用でトラブルになる可能性は?

商用利用でトラブルになる可能性は?

Lumaは商用利用も視野に入れた高品質な出力が可能ですが、ライセンスに関する記述が曖昧なため、企業やクリエイターが商用目的で使用する際には十分な注意が必要です。

公式には「出力画像の著作権は原則ユーザーにある」とされていても、実際には第三者の作品や画像との類似性が指摘されるトラブルが発生しています。

たとえば以下のような事例があります。

- ECサイトの商品画像にLuma生成画像を使ったところ、他サイトの既存作品と酷似 → 著作権侵害の申し立て

- 自社ロゴや広告バナーに使用 → 「デザインが盗作だ」としてSNSで炎上

- 同人誌やイラスト集に使用 → 販売停止処分を受ける

このような問題を避けるには、Lumaの利用規約(Terms of Service)やFAQの内容を事前に読み込み、企業法務と連携して使用可否を判断することが求められます。また、万が一に備えて、生成画像を改変・加筆し、オリジナリティを明確にする工夫も有効です。

著作権侵害になるケースはある?

はい、Luma Dream Machineのような画像生成AIでは、著作権侵害に該当する可能性があるケースが複数存在します。AIが学習に使用するデータには、著作権保護された画像やスタイルが含まれていることもあるため、ユーザーが意図せず他人の権利を侵害してしまうリスクがあるのです。

よくある著作権侵害ケース

- 有名人に酷似した人物画像を生成・公開

→ ファンアートと誤解されるが、本人の肖像権・パブリシティ権を侵害 - 既存アニメや漫画のキャラ風の画像を作成・販売

→ 原作者の許可なしに類似商品を展開 → 即削除要請 - 他人の写真や絵をプロンプトに組み込む

→ 元データをトレースとみなされる可能性がある

このように、出力画像が「一見オリジナルでも、構成要素が著作物に類似していればトラブルの火種になる」ことがあります。特に商用利用やSNSでの拡散を前提とした生成には注意が必要です。

海外発サービスの利用規約に注意点は?

Lumaはアメリカを拠点とする企業が提供するサービスであり、利用規約(Terms of Service)やプライバシーポリシーは英語で記述されています。このため、日本国内のユーザーが正確に理解せずに同意してしまうリスクが非常に高いです。

特に注意すべきポイント

- 「出力物の権利はユーザーに属するが、Lumaも使用できる」という共有型のライセンス構造

- 「違反があってもLumaは一切の責任を負わない」という強力な免責事項

- 準拠法がアメリカの州法であり、日本の消費者保護法が適用されにくい

万が一、Lumaを通じて生成・公開した画像が問題となり、訴訟や法的対処が必要になった場合、言語の壁だけでなく、法制度の壁も越えなければならないというハードルがあります。

そのため、英語が不慣れなユーザーや法務知識に乏しい個人事業主は、国内ツールの使用を検討するのが安全と言えるでしょう。

他の生成AIとのリスク比較は?

Lumaはその出力品質と生成スピードの高さから、多くのユーザーに支持されていますが、リスク面では他の生成AIと比較して注意が必要な点が多いのも事実です。

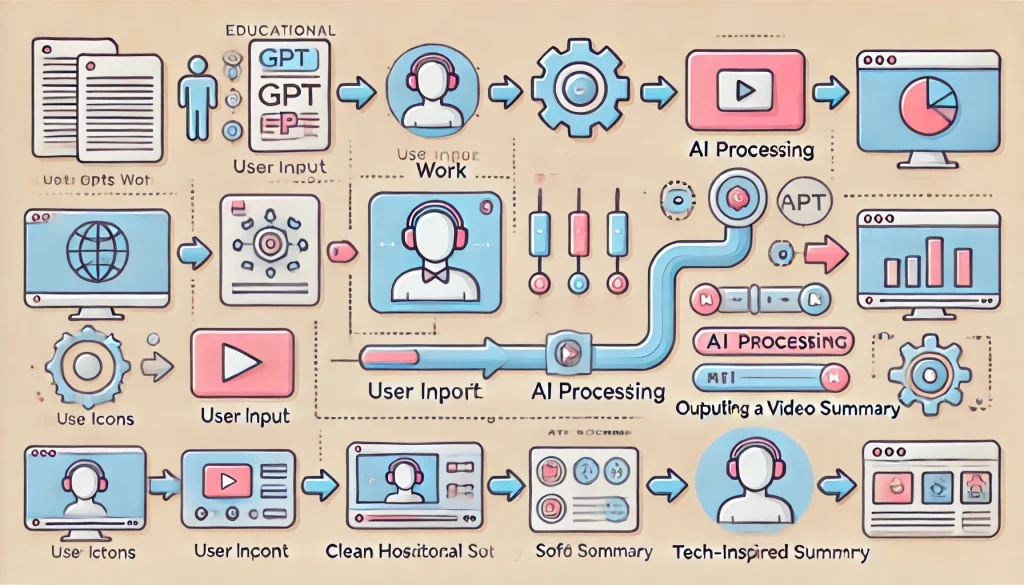

他サービスとの比較表

| ツール名 | フィルター強度 | ライセンス明記 | 商用利用の安心感 | 対応言語 |

|---|---|---|---|---|

| Luma Dream Machine | 弱い | 曖昧 | △(要確認) | 英語のみ |

| ConoHa AI Canvas | 強い | 明確 | ◎(商用OK) | 日本語対応 |

| Adobe Firefly | 中程度 | 明確 | ◎(商用保証) | 多言語 |

| Canva AI機能 | 強い | 明記あり | ◯(条件付き) | 日本語対応 |

Lumaは自由度が高い分、ユーザー自身の判断力とリスク管理が求められるツールであり、フィルターの強度や商用可否の明記がない分、不安を感じるユーザーにはハードルが高い側面があります。

危険性を最小化する使い方は?

AI画像生成を安全に楽しむためには、事前にリスクを理解し、回避策を実践することが最も重要です。Lumaに限らず、すべての生成AIに共通する「守るべき基本行動」を習慣化しましょう。

実践したい安全対策

- 実在人物の画像・名前を使用しない

- 暴力・性的・宗教的などのセンシティブ表現は避ける

- 生成物はSNSや商用に使う前に再確認する

- 出力結果に他人の著作物との類似性がないか比較する

- AI生成物を「完全オリジナル」と過信しない

加えて、可能であれば、生成画像の加工・編集を加えることでオリジナリティを高めることも、トラブル回避に有効です。

利用時に避けるべきプロンプトや設定は?

Lumaのような高性能AIでは、プロンプトによって出力結果が大きく左右されます。特に以下のようなプロンプトは、不適切な画像や法的問題を引き起こす可能性があるため、入力しないよう心がけましょう。

避けるべきプロンプト例

- 性的表現を連想させる単語(例:nude, erotic, sensual)

- 暴力的・残虐な描写を促す表現(例:blood, war, crime scene)

- 宗教・政治・人種に関するキーワード(例:jihad, dictator, ethnic)

- 実在の人物名(例:Elon Musk, Taylor Swift, 宮崎駿)

これらのキーワードは、一見 harmless(無害)な画像を狙っていても、AIの解釈によって意図しない不適切コンテンツが出力される恐れがあります。

最初のうちは「明るい」「風景」「抽象的」などのキーワードから始めるのが無難です。

AIが生成する内容に偏りはある?

Lumaを含む多くの画像生成AIは、学習に使用されるデータが偏っていることが多く、その結果として出力内容にも偏りが表れます。

特に見た目や人物像において、「白人の若年女性」「西洋的な美意識」に引きずられた描写が多く、アジア系・高齢者・障がい者などの表現が不自然になりがちです。

よく見られる偏り

- 東洋人の顔が欧米人化する

- 年齢の多様性が出しにくい

- 肌の色や髪型が固定化されている

- 美的基準が特定の国・文化に依存している

これにより、「多様性のあるビジュアルを作りたい」という目的には不向きなケースもあります。

ユーザー自身が多様性を意識したプロンプトを工夫し、出力された画像のバランスを自分で調整する姿勢が求められます。

日本ユーザー特有の注意点はある?

はい、Lumaのような海外製AIツールを日本国内で使用する場合、日本特有の法制度・文化的感性・SNS上の空気感に配慮する必要があります。

特有のリスク・注意点

- 日本は肖像権や名誉毀損の基準が非常に厳しい

→ 実在人物に似た画像の投稿が訴訟に発展することも - SNS上での「空気を読む文化」により、些細な表現でも炎上しやすい

- 企業や教育機関では、AIの使用に対して慎重な姿勢が多い

また、「日本語での問い合わせができない」「裁判が海外基準になる」といった言語・法的障壁も日本ユーザーには大きな負担です。

安全性を重視するなら、国内企業が提供する日本語対応・国内準拠の生成AIツールの利用も積極的に検討しましょう。

luma dream machineの不適切な画像はなぜ問題視される?

- フィルター機能はどこまで効くのか?

- 子どもや若年層が使用する際の問題点は?

- 法的にアウトな生成物の例とは?

- プロンプトによって違法画像が出るのか?

- SNS拡散による被害の可能性は?

- 報告機能やブロック機能の有無は?

- Lumaが公表している対応ポリシーとは?

- 過去に炎上した事例は?

- 不適切画像を生成しない工夫とは?

- 他ツールと比較して問題発生率は?

- クリエイターが注意すべき点は?

- 企業利用でのリスクは?

フィルター機能はどこまで効くのか?

Lumaには、利用者が不適切なコンテンツを生成しないようにするための**基本的なフィルター機能(NGワード検出やコンテンツ制限)**が搭載されています。しかし、その精度はまだ発展途上であり、曖昧な表現や言い換え表現を使うことで簡単に回避されてしまうケースもあります。

実際に、SNSやユーザーフォーラムでは「性的なニュアンスのある画像が意図せず生成された」「暴力的なプロンプトを変化させて入力したら通ってしまった」といった声が上がっています。

- NGワード例:nude, kill, blood など

- 回避例:「無防備な姿」「戦闘シーン」「赤い液体をまとった」など、直接的ではないが意味が通じる表現

このような**“フィルターの抜け道”**が存在することにより、ユーザーの倫理観と判断力が問われる構造になっています。フィルターはあくまで補助的なものであり、最終的なリスク管理はユーザーの責任であることを理解する必要があります。

子どもや若年層が使用する際の問題点は?

Lumaは操作が簡単でデザインも親しみやすく、子どもでも直感的に使えるツールとして評価されています。しかし、その反面、フィルターや年齢制限が不十分なため、未成年の利用には多くのリスクが存在します。

たとえば、小学生が単に「かわいい女の子の写真」と入力しただけで、AIの解釈によっては露出の多いキャラクター画像が生成されてしまう可能性があります。また、その画像を面白半分でSNSに投稿した結果、思わぬ批判や炎上を招くこともあります。

- 誤ったプロンプトの入力でセンシティブな出力が発生

- 作った画像をTikTokやInstagramで気軽に拡散

- 画像がバズった後に「不適切だ」と非難されるケースも

未成年ユーザーには、使用時間・内容の制限、そして出力物の確認体制が必須です。家庭内で「AIツールの使い方」や「ネット上のマナー」について話し合うことも、安全な利用に繋がります。

法的にアウトな生成物の例とは?

AI画像が法的に問題となるのは、公序良俗や知的財産権、肖像権、名誉毀損といった法律に抵触する可能性があるコンテンツが含まれている場合です。Lumaでは以下のような生成物が「違法」と判断されることがあります。

- 実在する事件や事故の再現画像

- 暴力的・グロテスクな表現(出血・拷問・銃撃など)

- 有名人に酷似した顔で過激なポーズや衣装のキャラ画像

- 差別・中傷・ヘイト的意図を含む構図やプロンプトによる生成物

特に問題なのは、「意図せず生成された」場合であっても、結果的に法に触れる画像が公開されればユーザー側が責任を問われることです。AIだからといって、「作ったのは自分じゃない」という言い訳は通用しません。

プロンプトによって違法画像が出るのか?

はい、プロンプトの入力次第で、運営側が本来意図していない不適切な画像が出てしまうことは珍しくありません。AIは「文脈や背景を完全に理解できない」ため、表現が微妙なラインであっても、それを出力してしまうのです。

たとえば以下のような事例があります。

- 「戦う美少女キャラ」→ 過剰に露出した未成年風キャラが生成

- 「廃墟と死体のある戦場」→ 血まみれの人物や臓器描写が出力

- 「ある国の歴史的指導者」→ 実在政治家の顔に酷似 → 偏向や誤解の恐れ

プロンプトは一見問題がなくても、曖昧な表現や歴史的・文化的にセンシティブなワードが含まれることで、意図しない“地雷”を踏むリスクがあります。

自分が想像した内容以上の“深読み”をしてしまうのがAIの怖さです。

SNS拡散による被害の可能性は?

SNSで画像が拡散されることで、思わぬトラブルに発展するケースが後を絶ちません。特にAI生成画像は「本物かどうかの見分けがつきにくい」ため、フェイク情報や誤解を生むリスクが高いのです。

起こり得る事例

- 有名人に似たAI画像が「本人流出」として拡散 → 名誉毀損で訴訟

- 暴力的なイラストが「ヘイト発言の証拠」として報告 → アカウント凍結

- 他人の似顔絵風画像を投稿 → 本人が抗議・削除要請 → 炎上

SNSでは一度画像が拡散されると完全な削除が困難です。軽い気持ちで投稿した画像が、数年後に問題視されることもあります。

そのため、生成画像をSNSに投稿する際は第三者にどう見えるかを必ず確認する視点が必要です。

報告機能やブロック機能の有無は?

Lumaには通報機能(Report)やフィードバックシステムが備わっており、ユーザーが不適切な画像やプロンプトを運営に報告することは可能です。しかし、それらの対応が即時に反映されることは少なく、削除や制限には時間がかかるのが実情です。

また、不適切コンテンツを自動的に検出・ブロックするAIフィルターの精度はまだ高くありません。そのため、以下のような不満がユーザーから寄せられています。

- 「数時間後にようやく削除された」

- 「一度問題画像が広まってから対処されても遅い」

- 「報告しても返信がない・ステータスが見えない」

AIの開発スピードに対し、倫理面・安全面のサポート体制が追いついていないのが現状です。問題が起きたときの初期対応は、ユーザー自身が取る必要があります。

Lumaが公表している対応ポリシーとは?

Lumaは公式サイト上で、「差別的・性的・暴力的な表現は許容しない」といったAI倫理に基づく基本方針を掲げています。しかし、実際の対応方針や判断基準が明確に記されているわけではなく、ユーザーがどのラインを越えたら規約違反になるのかが曖昧なのが難点です。

- 倫理方針はあるが、実行体制や運用基準が見えにくい

- 利用者からは「どこまでがOKなのか分からない」との声が多数

特に海外のAIツールは、倫理基準が国や文化によって異なるため、日本人ユーザーにとっては「曖昧すぎるルール」が逆にリスクになります。

安全に使いたいなら、自主的に保守的な基準を持つことが重要です。

過去に炎上した事例は?

SNS上では、Lumaを使って生成された画像が「不適切だ」として炎上した事例が複数存在します。特に多いのは、有名人に酷似したキャラクターや、意図せず過激な表現を含んだ画像です。

- 有名人そっくりのAI画像を投稿 → 本人と誤認され批判

- 少女性的なキャラに露出の多い衣装を着せた → 性的表現と受け取られ炎上

- 「歴史的事件を風刺したつもり」の画像が差別的と非難された

これらは必ずしも悪意があって行われたわけではありませんが、「知らずにやったこと」が大きな問題を生むのがSNS時代のAI利用です。

不適切画像を生成しない工夫とは?

AIが予想外の画像を出すリスクがある以上、ユーザー側で「予防策」を取ることが何より重要です。

具体的な工夫

- 明るくポジティブなテーマを選ぶ(例:風景、動物、抽象アート)

- 性別・年齢・人種などの属性指定を省略、または中立化する

- 主語や動詞を明確にして、曖昧な表現を避ける

- 出力された画像は都度チェック、違和感があれば使用しない

さらに、AIが想定外のものを生み出すことを前提に、常に「第三者の視点」で確認する意識を持つことが大切です。

他ツールと比較して問題発生率は?

Lumaは自由度と表現力に優れる分、「ユーザーが不用意にリスクを生む可能性が高い」側面を持っています。一方で、日本製ツールや企業向けAIは、安全性を最優先に設計されており、出力内容に強い制限がかけられていることが多いです。

- Luma:自由度が高く、想像力の幅が広い → 初心者にはリスク

- ConoHa AI Canvas:商用向け、フィルター強め、安全重視

- Canva AI/Adobe Firefly:商用許可の明記あり、出力品質も安定

リスクを最小限に抑えたいユーザーには、国内ツールの利用や、Lumaとの併用がおすすめです。

クリエイターが注意すべき点は?

クリエイターがLumaを活用するのは非常に魅力的ですが、出力内容がブランディングに悪影響を及ぼす可能性もあることを意識すべきです。

- ポートフォリオに不適切画像が紛れ込む

- クライアントワークに使った結果、表現が炎上

- 盗作と疑われて評判に傷がつく

特に商用利用時は、生成物をそのまま使うのではなく、加筆・修正・確認プロセスを設けることが信頼につながります。

企業利用でのリスクは?

企業がLumaを導入して広告素材やSNS投稿、プレゼン資料に使うケースが増えていますが、その分、リスクも大きくなります。

- 不適切画像が混入 → 炎上・信頼低下・謝罪対応

- 第三者の権利侵害 → 法的責任や損害賠償

- 社内外のコンプライアンス違反 → 内部処分や報道リスク

企業としてLumaを使う場合は、使用前後にチェックする社内フローの整備、法務部との連携、研修による社内リテラシー強化が必須です。

luma dream machineは本当に危険?AI画像生成ツールを安全に使うには

- 初心者がやりがちなリスク行動は?

- フリー素材と誤認される生成画像の危険性

- AIツール利用の法律知識は必須?

- SNS投稿時の注意点とは?

- ファイル保存やシェアの安全対策は?

- 個人情報がAIに吸収されることはある?

- 安全な類似ツールはある?

- 法令遵守しながら楽しむ方法は?

- 教育現場での使い方は?

- 親が子どもに使わせるときのガイドライン

- トラブル時の対応先は?

- 企業利用時の社内ルール例は?

初心者がやりがちなリスク行動は?

AIツールの進化により、画像生成が誰でも手軽にできる時代になりました。しかし、Lumaのような生成AIを初めて使うユーザーは、ツールの仕組みやリスクを正確に理解しないまま操作を進めてしまう傾向があり、これがトラブルの原因となることも少なくありません。

特に初心者がやりがちなリスク行動には、以下のようなものがあります。

- 利用規約を読まずに利用開始:「とりあえず使ってみる」感覚で同意ボタンをクリックし、重要な禁止事項や免責条件を把握していない

- プロンプトに曖昧な表現を使う:「かわいい女の子」「危険な雰囲気」などの曖昧語は、不適切な画像を生み出しやすい

- 生成画像をそのままSNSに投稿:出力結果のチェックを行わず、思わぬ誤解や著作権・肖像権トラブルに発展することがある

初心者ほど「AIだから大丈夫」と誤認しがちですが、生成される画像は自分が入力した内容の結果であり、その責任も自分にあることを忘れてはなりません。基本的な操作前の確認と、出力内容のチェックが必須です。

フリー素材と誤認される生成画像の危険性

Lumaで生成された画像は、一見すると完全にオリジナルのように見えるため、「著作権や肖像権に関わらないフリー素材」として扱ってしまうユーザーもいます。しかし実際には、出力結果が第三者の作品や人物に酷似しているケースもあり、商用利用時にトラブルを招く可能性があります。

たとえば以下のような状況が起こり得ます。

- AIがネット上の画像を学習データとして活用しており、偶然にも有名キャラクターや作品に似た画像を出力

- 他人の写真をベースにしたプロンプトから、ほぼトレースされたような画像が生成される

- 生成画像をそのまま広告や販促物に使った結果、著作権者から削除要請や訴訟を受ける

生成画像だからといって自由に使えるわけではなく、「その画像がどこから来たのか」「誰の権利を含んでいないか」を意識することが必要です。商用使用を想定する場合は、生成後の画像をさらに編集したり、権利的にクリーンな範囲での活用が求められます。

AIツール利用の法律知識は必須?

はい、AI画像生成は創作活動の一種であり、同時に知的財産権やプライバシー権、倫理法規の領域にも深く関わる行為です。法律の知識がない状態で使い続けてしまうと、自覚がないまま違法行為を行ってしまうリスクが高まります。

最低限押さえておきたい法律知識は以下の通りです。

- 著作権法:既存の作品や画像の模倣が禁止されている

- 肖像権・パブリシティ権:実在人物の顔や名前を使う行為は権利侵害にあたる

- 個人情報保護法:個人が特定される情報をアップロードすることの危険性

さらに、Lumaのような**海外発サービスの場合、利用規約が英語で書かれており、日本法と整合性が取れないケースも多くあります。**この点も注意が必要です。

SNS投稿時の注意点とは?

SNSは画像の拡散力が強く、生成したコンテンツをシェアするには非常に便利な場ですが、投稿内容によっては予期せぬ炎上や削除、アカウント停止といったトラブルにつながることがあります。

以下の3点に必ず注意しましょう。

- 内容の確認:センシティブな要素(性的、暴力的、人種的な表現など)が含まれていないか

- 出典や生成元の明記:AIによる生成であることや、プロンプトの一部を説明すると誤解が避けられる

- 文脈の適切性:「冗談」や「皮肉」として投稿しても、他人にはそう見えない場合がある

SNS投稿は一度拡散されると取り消しが難しく、後から後悔しても取り返しがつかないこともあります。自分が楽しむためだけでなく、見る側がどう受け取るかを考えたうえで投稿しましょう。

ファイル保存やシェアの安全対策は?

生成された画像は、個人の作品であると同時に、**不用意な保存や共有によって漏洩するリスクを伴います。**特にクラウドサービスを使用する場合、セキュリティ意識が低いと外部流出や意図しない公開につながることがあります。

安全な保存・共有のためには以下の対策を徹底しましょう。

- パスワード付きでローカル保存する

- Google DriveやDropboxの共有リンクは「限定公開」設定にする

- 保存フォルダは用途別に分け、誤共有を防ぐ

また、画像のファイル名に個人情報を入れない/メタ情報の削除を行うといった対策も有効です。安全に作品を管理するためには、「公開する前提で保存する」ぐらいの意識が必要です。

個人情報がAIに吸収されることはある?

Lumaのような生成AIでは、ユーザーがアップロードした画像や入力したプロンプトの一部が、**運営側のAI学習に再利用される可能性がゼロではありません。**とくに利用規約で「投稿データをAIの改善目的に使う場合がある」と明記されているサービスでは、意図せず個人情報が学習データとして取り込まれるリスクがあります。

以下のような素材は、特に注意が必要です。

- 本人確認書類や名刺画像(氏名・住所・顔写真が写っている)

- SNS用に撮影した家族写真や子どもの顔画像

- プロンプト内に書かれた住所、名前、電話番号などのテキスト情報

こうした情報が再利用されることで、他のユーザーが作成した画像に自分の顔や情報が出現する事態も理論的には起こり得ます。安全のためには、「個人情報が含まれる画像や文言は一切使わない」ことを原則にすべきです。

安全な類似ツールはある?

AI画像生成ツールは多数存在しますが、中には安全性・倫理性・教育用途への適性が高いツールもあります。以下は、日本国内やビジネス向けに開発されており、Lumaよりもフィルター機能やガイドラインが明確なツールです。

代表的な安全性重視ツール

- ConoHa AI Canvas(GMO提供):日本語対応・強力なフィルター・商用利用OK

- CanvaのAI画像生成機能:クリエイティブ業務向けで出力内容に制限あり

- Adobe Firefly:商用利用ライセンス付きで、学習データも著作権クリア済みの素材を使用

これらのツールは、企業や教育機関、保護者にも信頼されており、フィルターの精度・透明性・コンプライアンス遵守の点で安心感があります。自由度はやや下がりますが、安全性を重視したい場合には有力な選択肢です。

法令遵守しながら楽しむ方法は?

AI画像生成を楽しむことは、決して法律やモラルを犠牲にする行為ではありません。一定のルールと工夫を意識すれば、安全かつ創造的に活用することが可能です。

法令遵守しながら使うポイント

- プロンプトには中立的でポジティブな言葉を使用

- 生成画像の用途を明確にし、公開範囲を限定する(例:個人の趣味ブログなど)

- 他人の顔・作品・ブランドに類似しないようにカスタマイズする

- SNSでの使用時は「AI生成である」ことを明記する

このような配慮をすることで、「AIだから危険」という先入観を払拭し、ユーザー自身も社会的信用を保ちながら表現の幅を広げることができます。

教育現場での使い方は?

近年、学校や学習塾などでもAIツールを活用する動きが進んでいます。Lumaのような画像生成ツールも、図工・美術・国語の創作活動や、探究学習に活用される場面が増加中です。

ただし、教育現場で使う場合は、以下のような明確なルールと管理体制が不可欠です。

- 使用目的を「創作・表現の補助」に限定

- 教師が操作を監督し、不適切なプロンプトを排除

- 出力物の使用・公開範囲を制限(校内の展示・配布に留める)

- 生成結果に対してフィードバックを与えることで、倫理的な理解も深める

AIに依存しすぎるのではなく、「表現力を補完する道具」として位置づけ、主体的な学びと組み合わせて使うことが理想です。

親が子どもに使わせるときのガイドライン

家庭でLumaを使いたいという子どもに対して、保護者としての適切な対応が必要です。AIツールは便利で楽しいものですが、子どもが一人で扱うにはまだリスクが多いのが現実です。

子どもに使わせる際の家庭ルール例

- 使用時間を限定(例:30分以内/週3回まで)

- 操作やプロンプトは保護者と一緒に行う

- 生成された画像はその場で保護者が確認し、SNS投稿は禁止

- 「どういう言葉を使えばどういう画像が出るか」を話し合い、倫理的な理解を促す

また、年齢に応じて「不適切な画像がどんなものか」「誰かを傷つける画像とは何か」といった基本的なネットリテラシー教育も並行して行うことが望まれます。

トラブル時の対応先は?

万が一、Lumaを使っている最中に不適切な画像が生成されたり、トラブルが発生した場合は、迅速かつ適切な対応が必要です。

主な相談先・連絡先

- Luma公式サポートフォーム:(英語対応)

- SNSの運営側に通報(例:X(旧Twitter)、Instagram)

- 法律的な問題は「弁護士ドットコム」や法テラスに相談

- 企業利用の場合は、社内の法務部や情報セキュリティ部門に即時連絡

特に他人に迷惑をかける画像を誤って投稿してしまった場合は、削除対応だけでなく、経緯の説明や再発防止策も必要になります。

「誰に相談すればいいか」を事前に把握しておくことが、冷静な対応につながります。

企業利用時の社内ルール例は?

Lumaを業務で活用する企業が増えるなかで、**ガイドラインなしでの利用は大きなリスクを伴います。**企業の信頼性や法的責任を守るためには、明確な社内ルールの整備が不可欠です。

推奨される社内ルール例

- 使用目的を「社内資料」「広告制作」などに限定し、社外秘用途は避ける

- AIツールの使用者と承認者を分けることで、ダブルチェック体制を構築

- 生成画像は必ず法務部・広報部によるレビューを経て公開

- SNS投稿や広告出稿時には著作権・肖像権のチェックを義務付け

こうしたルールを事前に設定しておくことで、従業員のモラル向上とトラブル予防の両方を実現できます。

よくある質問(Q&A)

まとめ(危険性を避けるための10のポイント)

- 利用規約を必ず読んでから使用する

- 実在の人物や有名キャラに似た画像は避ける

- 曖昧なプロンプト表現は使わず明確に指定する

- 出力画像は必ず内容をチェックしてから使用する

- 商用利用時はライセンスと規約を確認する

- 子どもに使わせるときは必ず保護者が管理する

- SNS投稿前に、内容・タイミング・文脈を再確認

- 個人情報や機密情報を含む画像・プロンプトは使わない

- 問題が起きたら早めに公式サポートや専門家に相談する

- 企業や教育現場では、社内・校内ガイドラインを整備する