NotebookLMは、Googleが提供するAIノートアシスタントとして注目されている便利なツールです。

PDFやGoogleドキュメントを読み込んで内容を要約したり、質問に答えてくれたりと、まるで“自分専用の知的パートナー”のように使えるのが特徴です。

ただし、そこで気になるのが「情報は漏れないの?」「機密情報をアップしても大丈夫?」といったセキュリティ面。特にビジネスで使いたい人にとっては、クラウド上にデータを渡すこと自体が不安に感じられるのも無理はありません。

この記事では、NotebookLMにおける情報漏洩のリスクや仕組み、安全に使うための注意点をわかりやすく解説します。他のAIツールとの比較や、社内での安全な運用方法まで、実務に役立つ視点で丁寧にお伝えします。

- NotebookLMは情報をクラウド上で処理するため、使い方次第でリスクがある

- Googleは機密情報の再学習には使わないと明記しているが、完全な閉域処理ではない

- 安全に使うためには「誰に見せても大丈夫な情報だけを使う」ことが大前提

- 社内利用の際には、AI活用ガイドラインの整備とアカウント管理が不可欠

notebooklmで情報漏洩は起こる?安全性を検証

- notebooklmとは?どんなAIサービス?

- 情報はクラウドに保存されるの?

- Googleはデータを閲覧・学習に使う?

- 情報漏洩のリスクがあるとすればどこ?

- notebooklmのセキュリティ対策は?

notebooklmとは?どんなAIサービス?

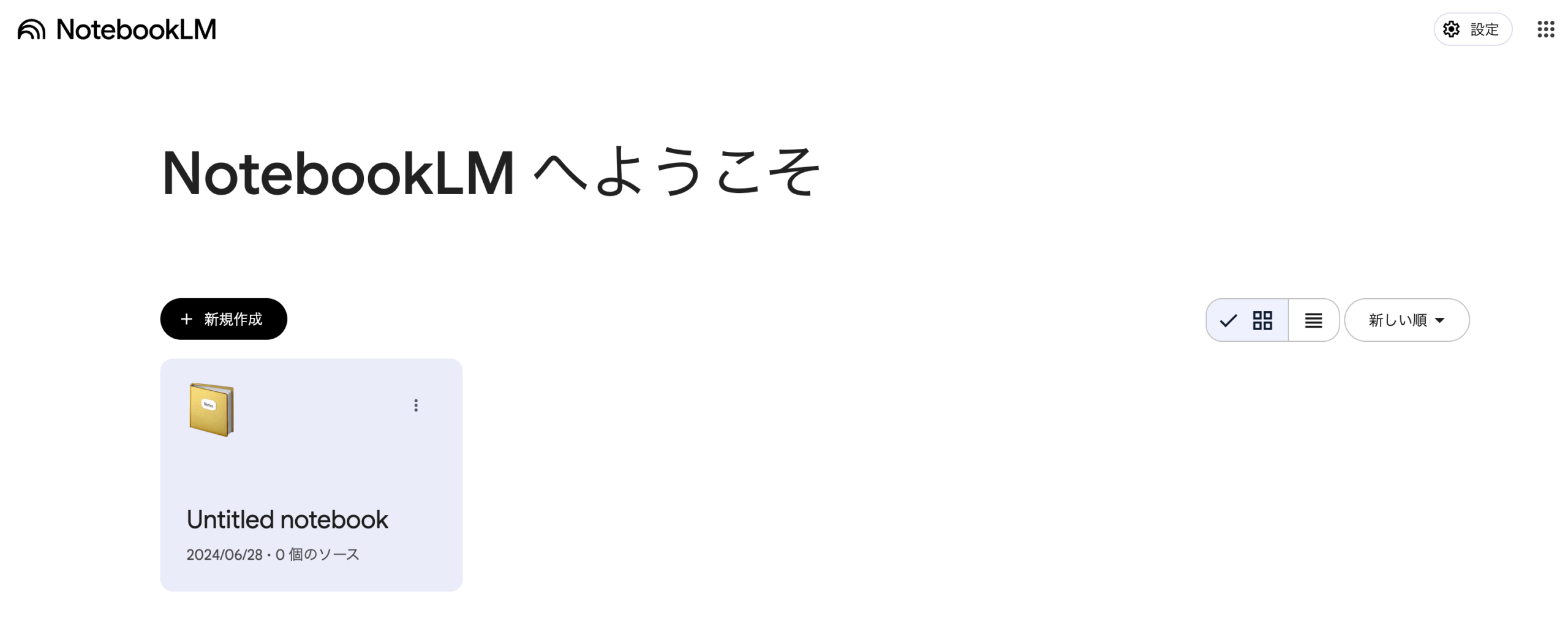

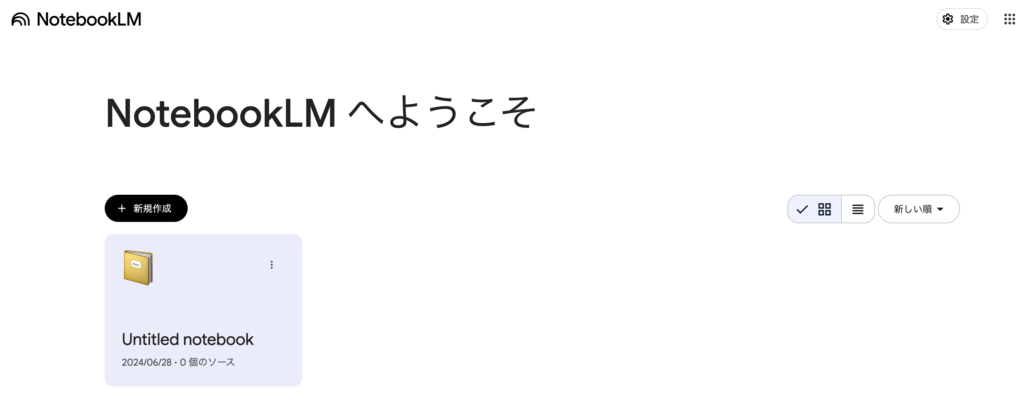

NotebookLM(ノートブック・エルエム)は、Googleが提供するAIノートアシスタントです。

PDFやGoogleドキュメント、スプレッドシートなどのファイルをアップロードすると、内容を自動で要約したり、質問に答えてくれたりする対話型AIノートツールとして注目を集めています。

「Gemini(旧Bard)」ベースの会話エンジンを使っており、自分だけの“知識ベースAI”を構築できるのが大きな魅力です。

情報はクラウドに保存されるの?

はい、NotebookLMにアップロードされたファイルはGoogleアカウントに紐づいたクラウド上のストレージに保存されます。

そのため、完全にローカル環境で閉じた利用ではないという点は注意が必要です。

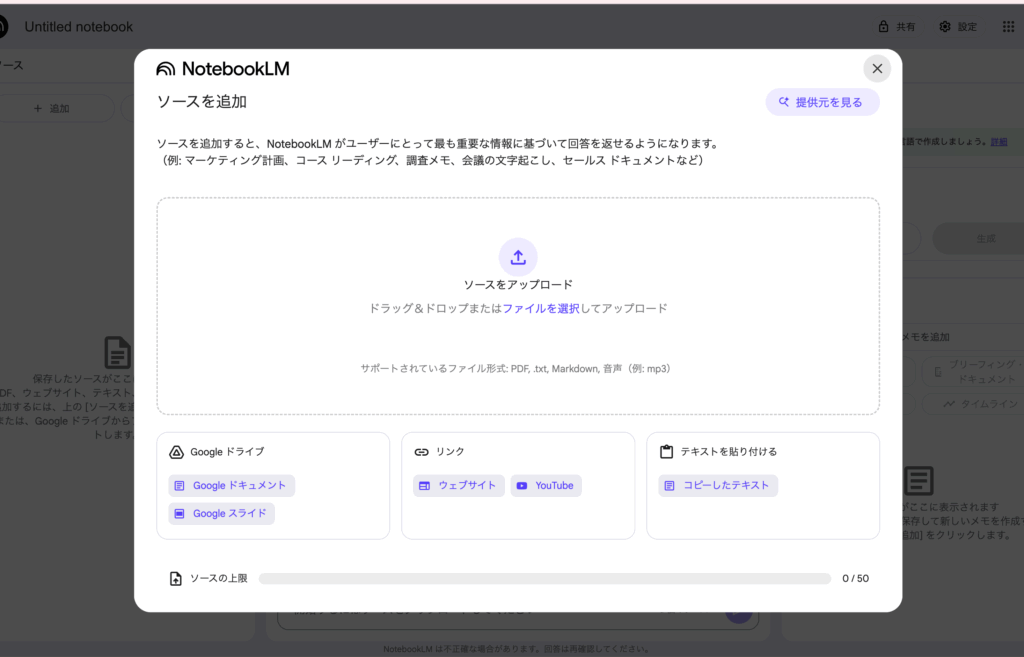

- PDF・Googleドキュメント・Googleスプレッドシートなどが対象

- Gemini APIを通じて「ファイル内容を学習させる」仕組み

- 会話の内容もクラウド側に一時的に保存される設計

この構造上、「自分以外がアクセスする可能性はゼロではない」という前提で利用すべきです。

Googleはデータを閲覧・学習に使う?

「NotebookLM にアップロードされた情報は Gemini モデルの再学習には使われません」

つまり、自分のファイルがGoogle全体のAIモデルに使われることはないと明記されています。

ただし、利用の安定性や品質向上のために一定のログ情報は収集される可能性があります(利用規約に準ずる)。

情報漏洩のリスクがあるとすればどこ?

アカウントの不正アクセス

Googleアカウントが乗っ取られると、NotebookLMの情報にもアクセス可能に。

共有設定の誤操作

Googleドキュメントの共有範囲を「全員」にしていたなどのヒューマンエラー。

誤ってAIにセンシティブな情報を渡してしまう

会話内に機密情報を書き込んだまま保存。

NotebookLMそのものが「故意に情報を漏らす」ことはありませんが、使い方を間違えると漏洩に繋がるリスクがあるのは事実です。

notebooklmのセキュリティ対策は?

Googleのプロダクトらしく、NotebookLMも以下のような強固なセキュリティ基盤に守られています。

- Googleアカウントの2段階認証

- クラウドストレージの暗号化(TLS/SSL、AES256)

- 利用ログの透明性ダッシュボード提供

- 利用者のプライバシー設定で個別制御が可能

とはいえ、セキュリティ対策は“ツール側”だけでなく“使う側”の意識も重要です。

notebooklmで情報漏洩対策|アップロードできる情報の注意点

- 機密文書や個人情報は扱って大丈夫?

- アップロードされたソースは暗号化される?

- 利用規約に書かれている“共有範囲”とは?

- 情報を削除・非公開にする方法は?

- チーム利用時に注意すべきポイントは?

機密文書や個人情報は扱って大丈夫?

原則として、NotebookLMは業務用・機密用途の文書アップロードを推奨していません。

Googleも明記しています。

「NotebookLMは現在研究・教育・個人利用向けです。機密情報や法的に保護された情報の取り扱いにはご注意ください」

つまり、社外秘の提案書・顧客リスト・クレジットカード情報などはアップロードNG。

万が一情報漏洩が起きても、責任はユーザー側に問われる可能性があります。

アップロードされたソースは暗号化される?

はい、すべてのデータはGoogle Cloudの標準プロトコルに従って暗号化されます。

- 転送中のデータ → TLS/SSL暗号化

- 保存時のデータ → AES 256ビット暗号化

また、ユーザーごとのアクセス制御もされており、「NotebookLM内で誰がどの情報を参照できるか」も管理可能です。

利用規約に書かれている“共有範囲”とは?

Googleドキュメントやスプレッドシートをソースとして使う場合、「共有設定」がそのまま適用されます。

- 共有リンクが「全員」になっていると、意図せず他人にも読まれるリスクあり

- NotebookLM上で「非公開」の設定にしていても、元のファイルが共有設定されていると意味がない

AIと共有の設定が一致していないと事故のもとになるので注意が必要です。

情報を削除・非公開にする方法は?

- NotebookLMのダッシュボードから「Remove source」で対象のファイルを削除可能

- アップロード済みのファイルはGoogle Driveからも削除しておくのがベスト

- 会話履歴も「Delete chat」で都度消去できる

「消す」「残さない」ことも安全な使い方のひとつです。

チーム利用時に注意すべきポイントは?

- チームメンバーが自由にファイルをアップロードできてしまうと管理が困難に

- NotebookLMは現時点では「個人用設計」が前提なので、共同利用はリスクが高め

「Google Workspace管理者がNotebookLMの利用を制限する」機能も今後登場する可能性がありますが、現状は企業利用には不向きといえます。

notebooklmで情報漏洩対策|安全な使い方と代替策

- 安全に使うために意識したいことは?

- 公開前提の情報だけを使うべき?

- パスワードやクレジット情報は入力NG?

- 他のセキュリティ重視AIツールとの違いは?

- 社内利用・業務利用する場合のチェックリストは?

安全に使うために意識したいことは?

安全に使うために意識したいことは?

NotebookLMは非常に便利なツールですが、使い方を間違えると情報漏洩やプライバシーのリスクにつながる可能性もゼロではありません。

そこで、安全に使うために特に意識したいポイントを以下にまとめました。

機密性の高いデータは使わない

まず大前提として、「社外秘の文書」「顧客リスト」「個人の連絡先」「金融情報」など、漏れたら大きな問題になる情報は絶対にアップロードしないようにしましょう。

たとえNotebookLM自体が安全に設計されていたとしても、ユーザーが不適切な情報を入力してしまえば意味がありません。

アカウントの2段階認証を有効にする

NotebookLMはGoogleアカウントと連携して動作しているため、アカウントの乗っ取り=情報漏洩に直結します。

2段階認証(2FA)を必ず有効化しておくことで、第三者による不正アクセスのリスクを大幅に下げることができます。

毎回の会話やアップロードは“誰に見せても問題ない内容”で

NotebookLMを利用する際は、常に「この情報は他人に見られても大丈夫か?」を自問する習慣を持つことが大切です。

特に生成AIにアップロードする情報は、一度AIの処理に渡ると完全な“削除”ができない可能性もあるため、入力の段階から慎重になるべきです。

定期的に履歴・ソースを削除する

NotebookLMは、会話履歴やアップロードされたドキュメントを元に返答を行います。

そのため、使い終わったら履歴やソースは都度削除するのが理想です。

- 「Remove source」機能でソース削除

- 「Delete chat」で履歴消去

- Google Drive上でも不要ファイルを削除

「残さない」ことが最も安全な情報管理です。

公開前提の情報だけを使うべき?

はい、それが基本の考え方です。NotebookLMをはじめとするAIツールは原則「公開しても問題のない情報だけを使うもの」と考えるのが賢明です。

具体的にはこんな情報が安全です

- 自分のブログ記事の下書き

- 自社Webサイトに掲載予定の文章案

- すでに公開済みの論文やリサーチ資料

- 広報用に作ったプレゼン資料

つまり、「誰かに見せることを前提に作っているもの」だけをAIに渡すようにすることで、意図せぬ情報漏洩を未然に防げます。

パスワードやクレジット情報は入力NG?

もちろん完全にNGです。

NotebookLMに限らず、AIツール全般においてパスワードやカード番号などのセンシティブ情報を直接入力するのは非常に危険です。

AIは一時的にそれらのデータを保持している可能性があり、ブラウザキャッシュ、API通信、セッション履歴など、人間の目に見えない形で“記録”されてしまうリスクもあります。

「AIは“外部にいる人”だと思って接する」ぐらいの感覚でちょうど良いでしょう。

他のセキュリティ重視AIツールとの違いは?

NotebookLMは「Google製のAIノートアシスタント」であり、情報の整理・読解支援に特化しています。

ただし、セキュリティや機密情報の管理を最優先にした設計ではありません。

以下に代表的なAIツールとの違いを簡単に比較します。

| ツール名 | セキュリティ特徴 | 備考 |

|---|---|---|

| NotebookLM | Googleによるデータ暗号化/Geminiは再学習不使用 | 個人利用に向いているが、情報保護は自己責任の側面もあり |

| Poe(by Quora) | ユーザーの会話は学習に使わない/履歴削除可 | 商用利用は非推奨、情報の一時保存あり |

| Claude(Anthropic) | プライバシー保護を設計思想に/法人向け契約あり | 機密文書の処理にも使われている事例あり |

NotebookLMは「安全だから選ぶ」というよりも、「使いやすいから選ぶ」「内容理解に強いから使う」タイプのAIです。

セキュリティを最優先するなら、Claudeのようなプライバシー設計型AIを検討するのも手です。

社内利用・業務利用する場合のチェックリストは?

もしNotebookLMを仕事やチームで使う場合は、社内でのルール整備と情報共有が必須です。以下のようなポイントをチェックしておきましょう。

- 機密情報は絶対にアップロードしない

- 利用者アカウントは2段階認証を必須に

- 編集・アップロードの操作権限を限定する

- 利用履歴や会話ログを定期的にチェック

- 使用後のドキュメントや履歴は都度削除

- 「AI利用ガイドライン」を社内で整備し、周知する

特に、「誰が、何の目的で、どのファイルをAIに渡すのか」を明確にしておかないと、万が一の事故のときに責任の所在が曖昧になりやすいため注意が必要です。

まとめ

- NotebookLMはGoogle製のAIノートアシスタント

- 情報はクラウド保存、暗号化はされているが完全な閉域ではない

- Geminiによる再学習には使われないと明記されている

- とはいえ機密情報の入力・アップロードは非推奨

- アカウントの2段階認証で不正アクセス対策を

- 履歴・ソースは定期的に削除するのがベスト

- AIには「公開前提の情報」だけを渡す意識が必要

- パスワード・カード番号などは絶対に入力しない

- 安全性重視ならClaudeなどのAIも視野に入れる

- 社内利用にはAI活用ルールの整備が不可欠